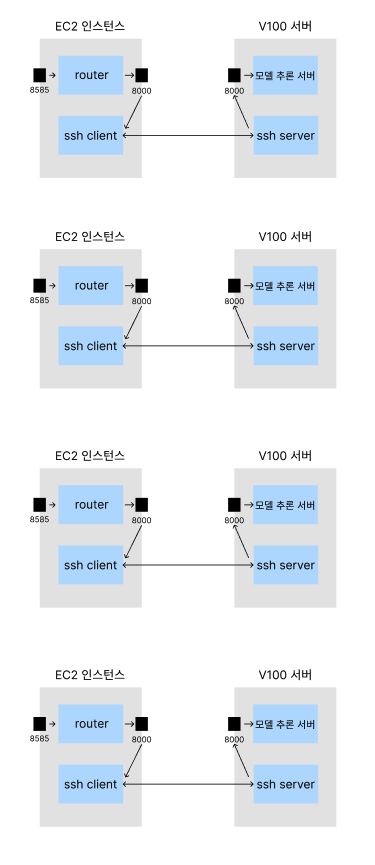

법률 조언 챗봇 프로젝트를 진행하기 위해 네이버 커넥트재단으로부터 제공받은 V100 서버 5대 중 4대를 모델 서버로 사용하고 1대를 CI 테스트 서버 및 모델 학습 서버로 사용하기로 계획했다. 따라서 이번 포스팅에서는 AWS ELB를 활용해 트래픽을 4대의 모델 서버에 분산시킨 방법을 작성해보려고 한다. Proxy 서버 역할의 EC2 인스턴스 생성 컨테이너로 패키징된 V100 서버가 외부와 통신하기 위해 각각의 V100 서버에 Proxy 서버의 역할을 하는 EC2 인스턴스를 ssh 포트 포워딩으로 연결했다. 이 EC2는 ALB(Application Load Balancer)로부터 넘어온 트래픽을 V100 서버로 전달하는 역할을 할 것이다. Application Load Balancer 이제 이 4대의 ..